Самохостятам привет!

В ролике мы с Вами живьем посмотрим:

- как связать нашу локальную Ollam’у живущую в openwebui с поисковым движком SearXNG

- как это использовать?

- на сколько быстро это работает на CPU среднего мини-пк?

- как себя видут разные модели? 0,8b\4b\9b

- как ограничить поиск конкретными ресурсами?

Для форумчан - я решил выложить краткое описание, чтобы Вы могли пробовать не дожидаясь ролика.

Настройка - крайне простая:

- у вас уже есть установленный поисковый движок SearXNG c включенным json форматом ответов

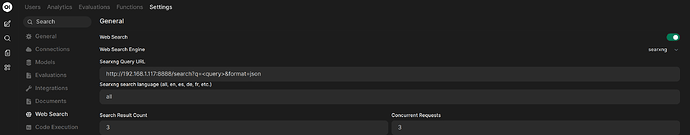

- заходим в настройки администратора → Web Saerch

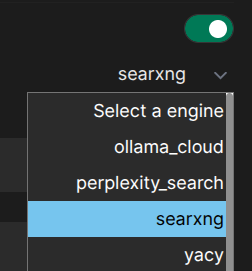

- справа включаем и выбираем движок searxng

- указываем путь до Вашего searxng в заданном формате

http://192.168.1.117:8888/search?q=<query>&format=json

- не забываем нажать SAVE внизу

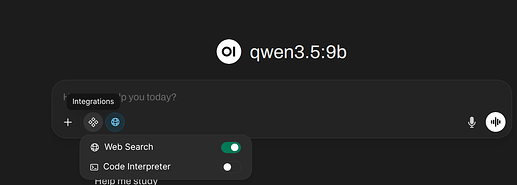

Как активировать функцию поиска?

В любом Вашем чате - нажмите на пиктограмму интеграций и включите веб поиск

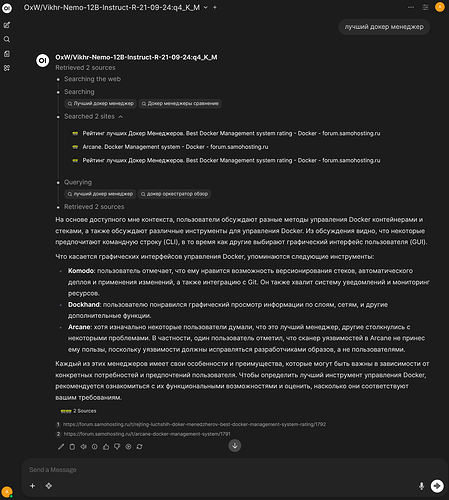

И вот Ваша моделька уже ходит по просторам сети и ищет ответы на Ваши вопросы: