Решил вынести Proxmox Backup Server на отдельную машину. Поскольку держать её включённой 24/7 не вижу смысла, реализовал у себя автоматическое включение и перевод сервера в сон по расписанию (cron) для экономии электроэнергии.

Попробую описать, как я это сделал — возможно, кому-то пригодится.

Настройка Proxmox Backup Server

Включение Wake-on-LAN в BIOS

Первым делом необходимо настроить BIOS. Он продолжает работать даже при выключенном компьютере (пока тот подключён к сети электропитания), в отличие от операционной системы.

-

Зайдите в BIOS, используя клавишу, подходящую для вашей материнской платы (чаще всего Del, Esc, F2, F12).

-

Найдите параметр, связанный с Wake-on-LAN. Обычно он расположен во вкладке Power, Power Management или Electropower.

-

Установите значение Enabled (или Automatic).

-

Сохраните настройки и перезагрузитесь (обычно клавиша F10).

Настройка WoL в системе PBS

Далее настраиваем сам Proxmox Backup Server через терминал.

Устанавливаем утилиту:

sudo apt install ethtool -y

Определяем сетевой интерфейс:

ip addr

Найдите интерфейс с локальным IP-адресом (например, 192.168.x.x или 10.10.x.x) и запишите:

-

имя сетевого устройства (например,

eno1) -

MAC-адрес

Проверяем поддержку Wake-on-LAN:

sudo ethtool eno1

Найдите строку Supports Wake-on. Если в ней присутствует буква g, значит WoL поддерживается.

Включаем WoL:

sudo ethtool -s eno1 wol g

Чтобы WoL включался автоматически при старте системы, отредактируйте конфигурацию сети:

sudo nano /etc/network/interfaces

В конец блока интерфейса (iface eth0 inet или аналогичного) добавьте:

post-up /usr/sbin/ethtool -s eno1 wol g

Сохранитесь и выйдите из редактора.

Для принудительного перевода сервера в спящий режим используйте:

systemctl suspend

Настройка Proxmox Virtual Environment

На сервере с Proxmox VE устанавливаем утилиту для пробуждения PBS:

apt install wakeonlan

Пробуждаем сервер с бэкапами командой:

wakeonlan xx:xx:xx:xx:xx:xx

(вместо x подставьте MAC-адрес PBS)

Если сервер включился — поздравляю, WoL работает корректно.

Настройка cron

На Proxmox Backup Server

Добавляем задание, которое будет переводить сервер в сон:

00 12 * * * systemctl suspend

Каждый день в 12:00 сервер будет уходить в спящий режим (если он включён).

На Proxmox VE

Добавляем задание для пробуждения PBS:

45 23 * * 7 wakeonlan xx:xx:xx:xx:xx:xx

Команда будет пробуждать сервер каждое воскресенье в 23:45.

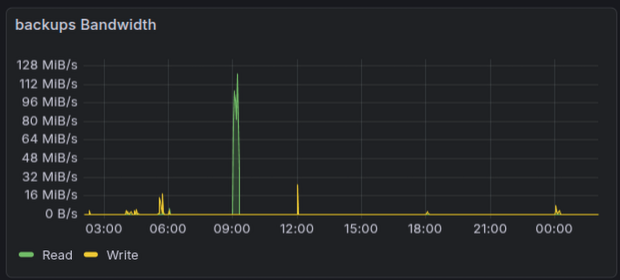

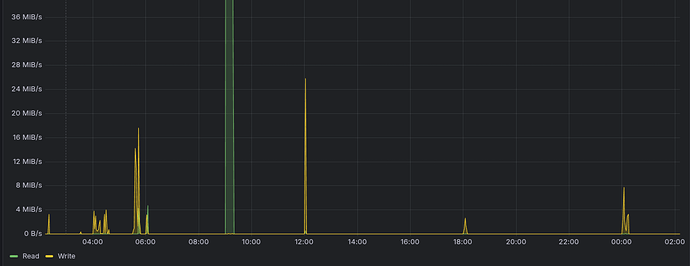

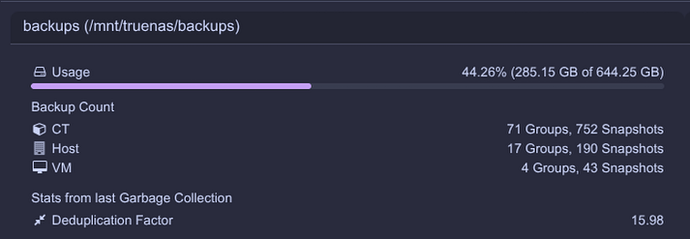

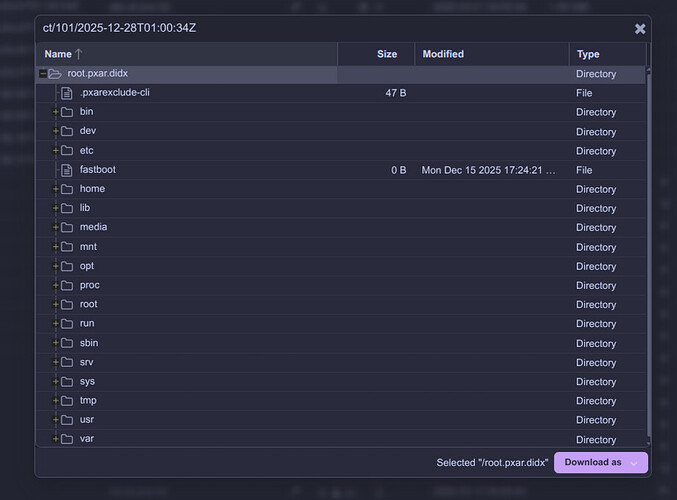

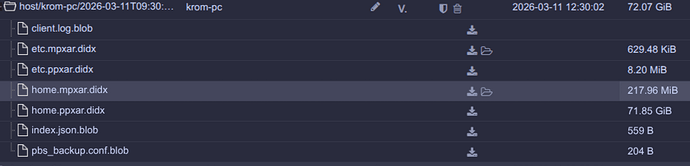

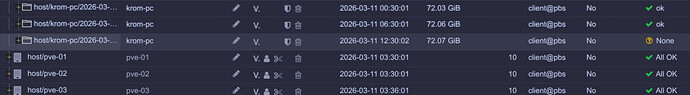

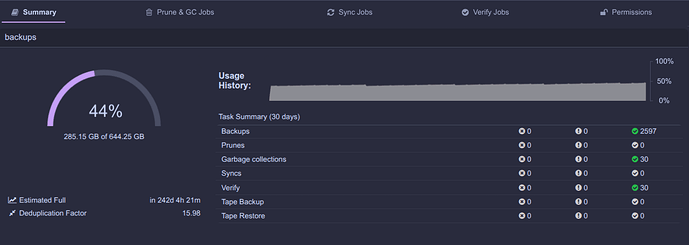

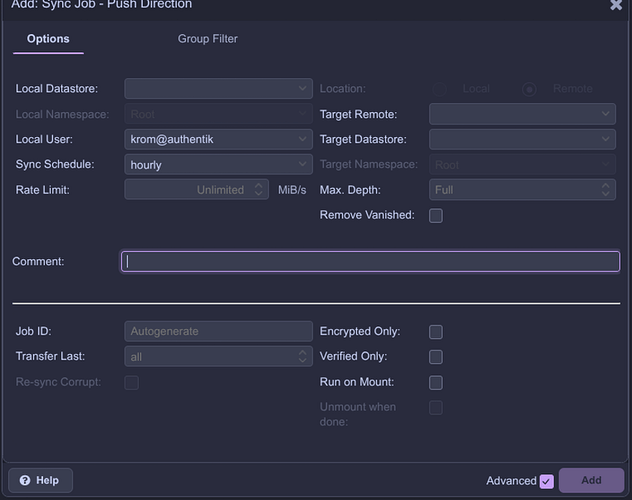

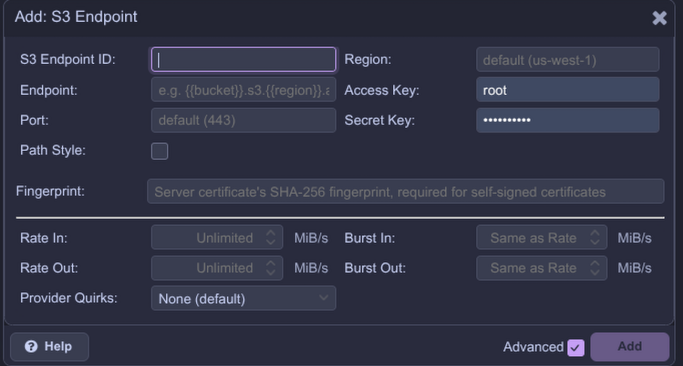

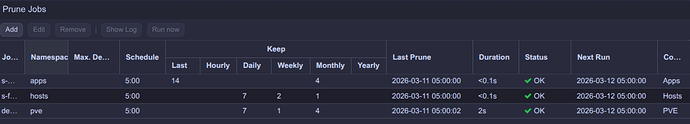

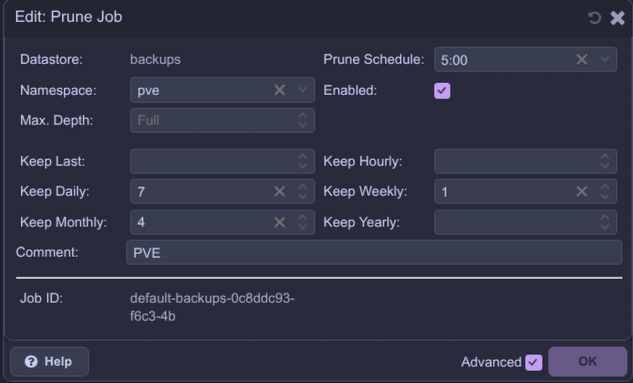

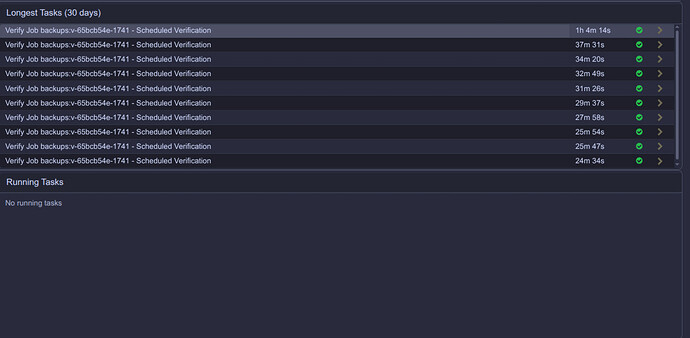

Все бэкапы и обслуживание настраиваем в интервале с 00:00 до 12:00.

У меня уже несколько бэкапов работают по такой схеме — полёт нормальный.

Не претендую на истину в последней инстанции, но для новичков, думаю, подойдёт.

Если у кого есть идеи или улучшения — пишите, будет интересно обсудить.