Самохостятам привет!

Тема навеяна недавним роликом Николаая Павлова,

те кто использует power query - уверен, чтр хорошо его знают.

И задача переключения на локальную ollama вроде и не тривиальная.

Но это когда, как говорит Николай “Когда знаешь - все просто!”

А когда ты новенький, примеры - лишними не бывают.

Так, что скоро запишу небольшой ролик, где мы посмотрим:

- особенности в запросах к локальной Ollama

- как будет вести локальная моделька на относительно мощном CPU mini pc(R 6900hx)?

- какая скорость решения?

- какую модельку лучше выбрать?

А пока - держите конфиг и спойлеры к ролику.

PowerQuery запрос

(Instruction as text, SourceData as text, Temp as number) =>

let

// Формируем prompt

requestBody = Json.FromValue(

[

model = "OxW/Vikhr-Nemo-12B-Instruct-R-21-09-24:q4_K_M", // ЗАМЕНИТЕ НА ВАШУ МОДЕЛЬ, например "llama3:8b", "mistral", "deepseek-coder:v2"

messages = {

[ role = "system", content = Instruction ],

[ role = "user", content = SourceData ]

},

temperature = Temp,

stream = false // важно: без stream=true, иначе ответ будет в формате SSE и не распарсится так просто

]

),

// Делаем POST-запрос к локальному Ollama

response =

Json.Document(

Web.Contents(

"http://192.168.1.72:11434/api/chat",

[

Headers = [ #"Content-Type" = "application/json" ],

Content = requestBody

]

)

),

// Извлекаем содержимое ответа

result = response[message][content]

in

result

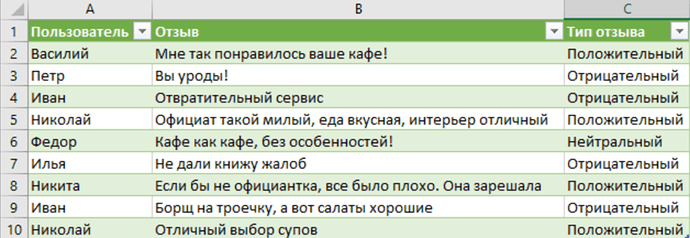

Мы с Вами будем решать простую, но не очень приятную для ручной обработки задачу: классифицировать отзывы людей =)